Token 工厂(即将开放注册)

按 Token 计费的大模型推理服务,覆盖主流领先的开源模型。兼容 OpenAI、Anthropic API,简单配置即可接入。

支持主流开源模型品牌:MiniMax · Kimi · GLM · Qwen · DeepSeek

MiniMax

主打长上下文与生产力场景,适合文档处理、摘要、多轮业务对话。

Kimi

多模态、超长上下文与代码类任务稳定,是 Agent 与研发工具链的常用底座。

GLM

在中文语料上具备优势,覆盖通用对话、工具使用与智能体工程。

Qwen

模型线完整,从端侧小模型到旗舰 MoE 均已覆盖,兼顾性能与成本。

DeepSeek

在推理、代码与数学任务上有口碑,MoE 路线提供了优秀的性价比。

GPU 服务(敬请期待)

原生基于国产 GPU 的算力服务,提供三种形态。GPU 服务产品尚未开放,欢迎联系销售预约早期访问。

GPU Instance

按需的单卡或多卡 GPU 实例容器,分钟级交付,按小时计费。

Bare-Metal

整机独占的 GPU 服务器,提供完整的硬件控制权与资源隔离。

Cluster

基于多节点组网的大规模算力池,面向大规模推理场景。

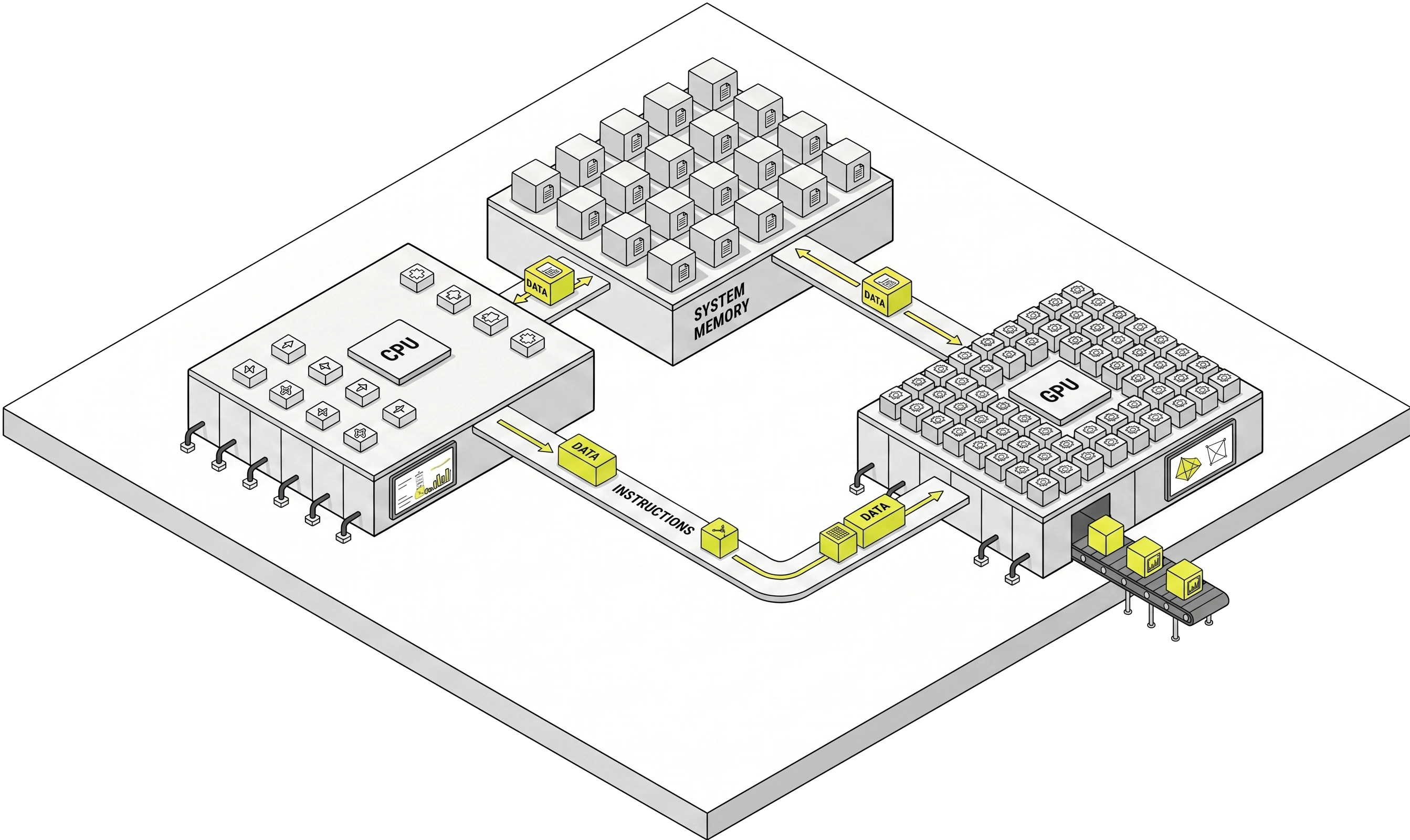

端到端的推理系统

国产 GPU超节点架构,系统级软硬件调优

深度整合的Token工厂

兼容性良好的 API

兼容 OpenAI 与 Anthropic API 规范,简单配置,即可使用。

全链路可观测

TTFT、TPS、缓存命中率及Token用量明细均实时可见。

系统级 KV 缓存加速

专属 KV Cache引擎,支持混合分层管理,显著加速推理。

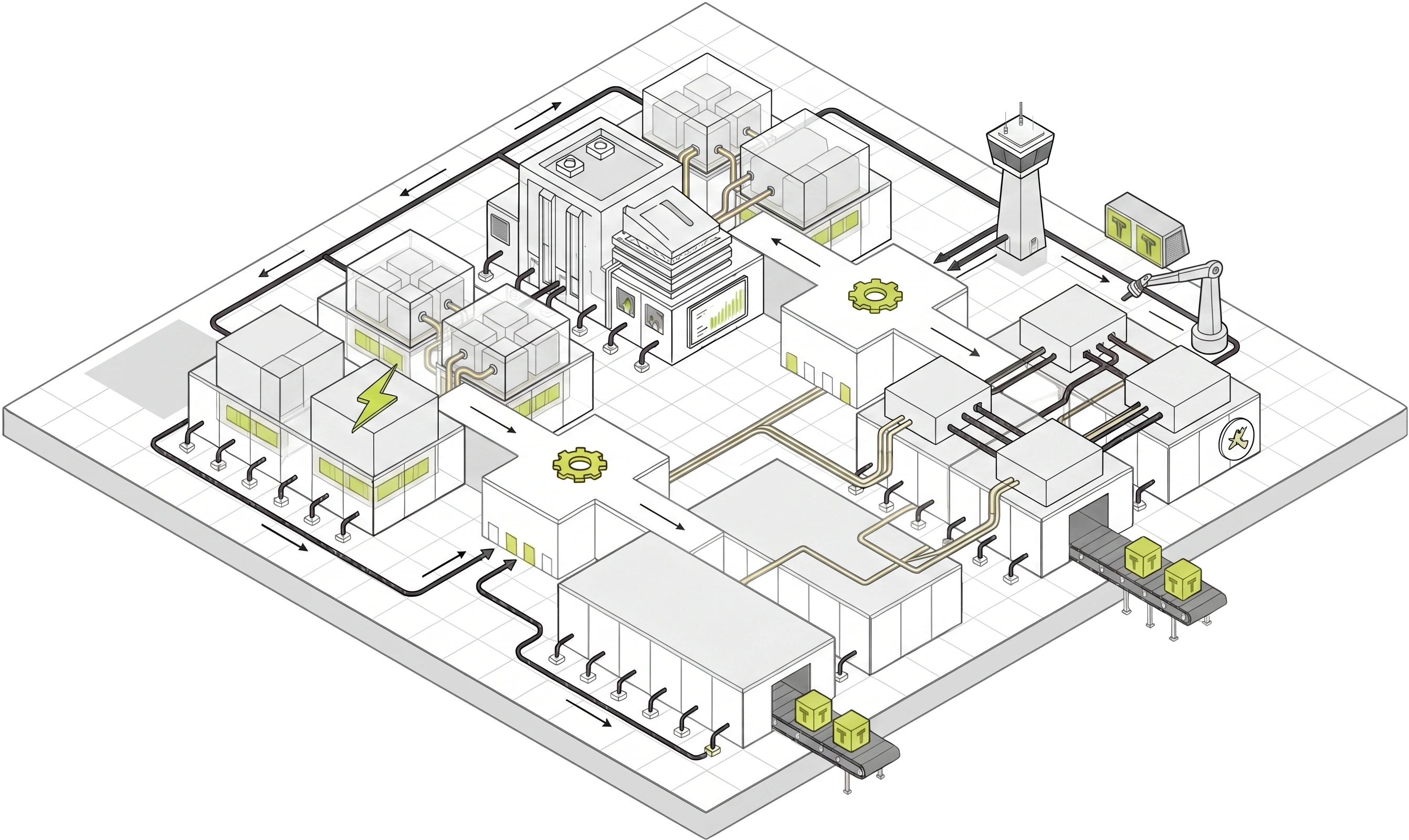

拓扑感知的 MoE 加速

通过超节点架构,实现对张量、流水线与专家并行(TP/PP/EP)的拓扑感知调度优化。

多节点高可用

具备面向大模型推理的多种调度策略,提供灵活、支持弹性扩缩容的GPU集群架构。

国产GPU基础设施

广泛支持包括寒武纪、壁仞、曦望、沐曦等在内的多家国产GPU厂商。

GPU 高性能互联拓扑设计

面向大规模推理,与 MoE 并行协同设计的 GPU 通信拓扑。

出色的推理能效设计

卧龙超节点平台对 GPU 调度、批处理与散热进行协同优化,为大规模服务实现高能效。

为大模型推理场景而设计

全栈协同设计

从硬件兼容性、超节点系统架构、模型推理引擎到API服务的端到端一体化云化基础设施,提升整合程度,降低性能损耗。

可用性 SLA

Token工厂可用性最高达 99.9 %,适配生产级负载。

运维负担

开箱即用的推理API,无需基础设施管理。

加速

依托系统级缓存技术,预填充速度可达常规方案的 10 倍。

国产芯片家族

壁仞、寒武纪、沐曦、曦望等多款国产算力原生兼容。

试用wylon新云的Token工厂

Token工厂已正式开放注册,几分钟内即可完成集成;GPU服务正在接受早期访问申请。